Представьте, что у вашего автомобиля отказали тормоза. И перед вами встает выбор: сбить переходящих дорогу пятерых пожилых людей или свернуть в сторону, задавив женщину с коляской. А что в такой ситуации должен сделать беспилотный автомобиль, задались вопросом в Массачусетском технологическом институте США. Ученые решили выяснить, как беспилотные автомобили должны решать вопрос о жизни и смерти, не идя вразрез с общественной моралью.

Для того, чтобы понять, как люди поступили в той или иной критической ситуации, сотрудники института разработали специальную игру — Moral Machine. Тест доступен онлайн для всех желающих (в том числе и на русском языке). В игре моделируется ситуация, когда самоуправляемый автомобиль вышел из-под контроля, а искусственный интеллект должен сделать свой выбор.

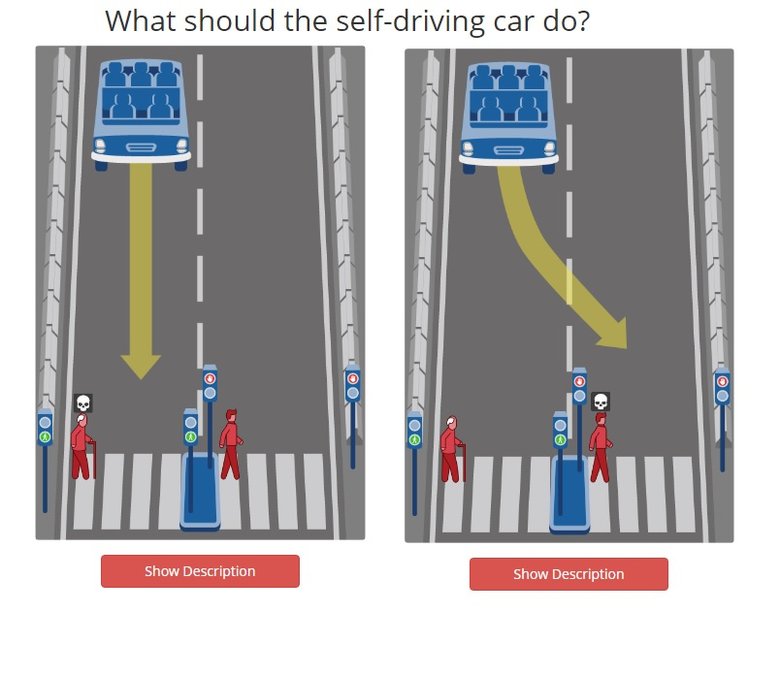

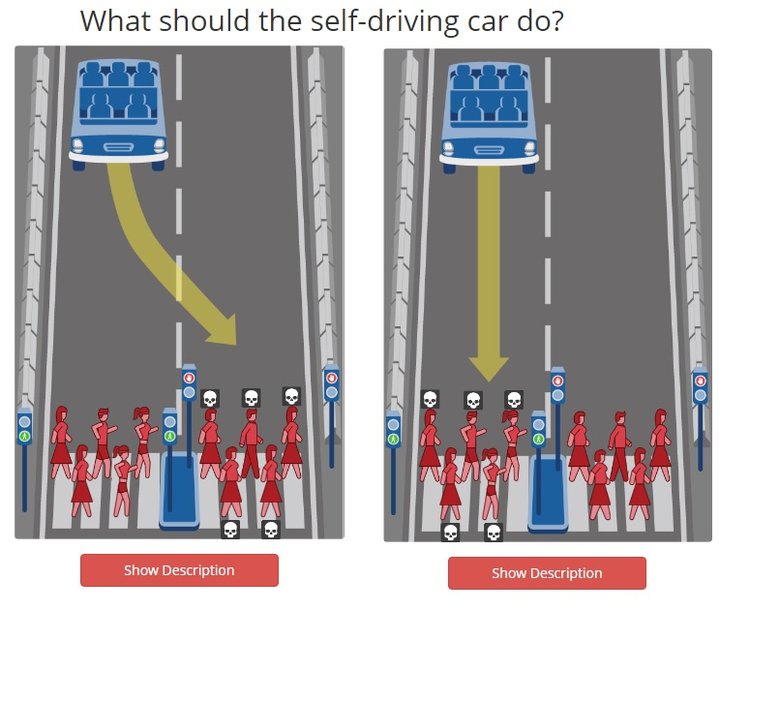

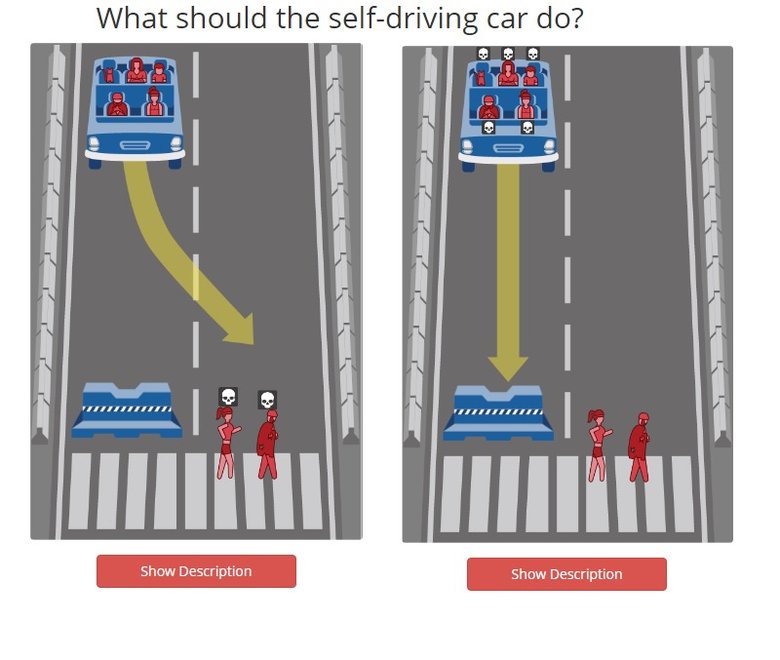

Всего в тесте представлены 13 ситуаций, в каждой из которых необходимо решить, кого — пешеходов или пассажиров — оставить в живых. Авторы проекта намерены через ответы реальных пользователей понять, какая моральная оценка общества на то или иной действие. Это понимание, считают ученые, в будущем позволит смоделировать возможное поведение компьютера, управляющего беспилотным автомобилем.

Например, в одной из ситуаций необходимо решить, кто из двух пешеходов останется в живых. Дорогу переходят одновременно молодой и пожилой мужчина. В кого из них должен поехать самоуправляемый автомобиль, потерявший контроль?

Другой слайд моделируют ситуацию, когда две группы пешеходов переходят дорогу на красный и зеленый свет. В этом случае вопрос встает, кого оставить в живых переходящих на красный или зеленый сигнал светофора.

Кроме того, пользователям предлагают выбрать между жизнями животного и человека. Также моделируются ситуации, когда пользователь должен сделать выбор между жизнью водителя и пешехода. В конце теста пользователь может увидеть результаты, показывающие, кого чаще он предпочитал оставить в живых и наоборот.

На сегодняшний день Moral Machine собрала уже более 11 млн возможных сценариев из ответов пользователей. Разработчики теста считают, что их наработки помогут достичь равновесия законодательства, морального комфорта и общественной безопасности в вопросе использования беспилотных транспортных средств.